聊到显微摄影,始终离不开一个词:放大倍率。

放大是显微镜以比其实际尺寸更大(或甚至更低)的比例产生物体图像的能力。只有当在图像中看到比肉眼观察物体更多的物体细节时,放大才有用。

部分无良商家会利用新手买家“放大倍率越高越清晰”这一错误认知来作为噱头,说自家显微镜放大倍率达到了几千甚至几万倍,这对新手有很大的吸引力。

对于显微系统来说,物镜分辨率才是最重要的指标,放大倍率只是个参考,因为放大倍率可以通过目镜、管镜、相机画幅、或电子系统进行调整,但具体能够分辨多少细节,主要还是看物镜的数值孔径。

宣称的放大倍数达到或超过1500,几乎可以肯定是把数码计算放大的结果也计算进去了。数码放大可以做到无限大,都是马赛克,并不会看清更多的目标细节。比如把一张2400w像素照片冲印成大厦喷绘,大倒是大了,但一看全是糊的,这样的放大倍率有啥意义呢……

摄影放大倍率

首先我们先来了解一下相机摄影中的放大倍率是如何解释的。

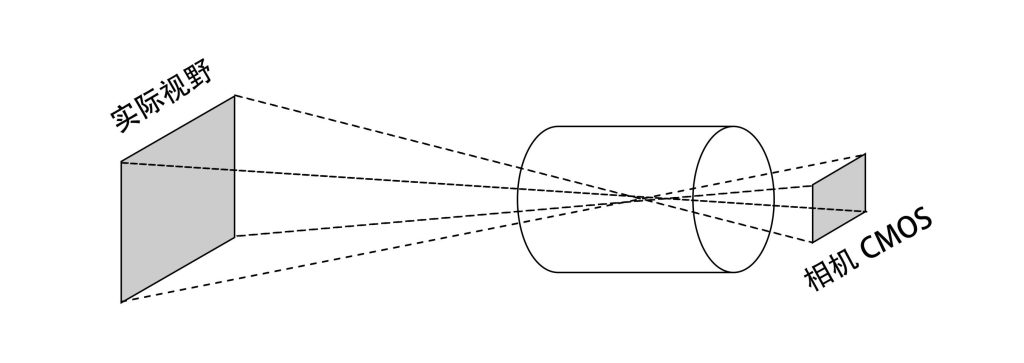

放大倍率是指物体通过透镜在焦平面上的成像大小与物体实际大小的比值。

光学放大倍率=相机cmos大小÷视场大小

举个例子:

以全画幅相机为例,其传感器大小24mm×36mm,当我们用一倍放大倍率的镜头时,一个24mm×36mm的物体刚好占满整个相机画面。当我们使用2倍放大镜头时,12mm×18mm的物体刚好占满整个相机画面,使用五倍时,就可以使4.8mm×7.2mm的被摄物体占满整个相机画面。

出个题目:被摄物体24mm×36mm的刚好占满M4/3相机画面,这个镜头的放大倍率是多少?

已知m4/3相机传感器尺寸是13mm×17.3mm,

对角线倍率计算:√(13²+17.3²)÷√(24²+36²)≈0.5倍

也就是说,同样使用一倍放大倍率的镜头,一个物体如果刚好占满m43画幅,在全画幅上,它就只能占一半的画幅。如果都放在手机上看拍出来的照片,反而是m43画幅拍出来的图像更大,这也是大家所说的:“画幅越小,放大倍率越高”。其实光学放大倍率没变,只是小画幅在大画幅中裁切出来了一块,被摄物体显得更大而已。

显微镜放大倍率

而在显微镜上,计算倍率的方法则是 物镜放大倍率×目镜放大倍率,完全靠光学放大的话,物镜的光学极限放大倍数是150倍,再加上10倍目镜可以达到1500的倍数。这就是纯靠光学放大的极限放大倍数。

虽然目镜是在物镜的成像上二次放大,并不会提高分辨率,但是由于人眼的观察距离和观察角的限制,目镜的二次放大可以获得了更大的放大倍率,并不会使成像模糊,反而何乐而不为呢?

但是在相机上就不同了,现代相机的高分辨率,好多物镜都“喂不饱”,如果这时候添加目镜,只会更加暴露物镜分辨率不足的缺点。

视觉倍率

无良商家所宣传的倍率

它们多半是指通过摄像头把显微镜放大图像投射到电脑屏幕上,在放大图像调到全屏时候,用电脑图像显示的尺寸除以被摄物体实际尺寸,计算出的“放大倍数”,用专业一点的词汇来说就是视觉放大倍率,它的放大倍率由物镜 目镜 相机传感器 数码放大 显示器大小共同决定,

举个例子:

100倍物镜+10倍目镜+1/2英寸相机+数码放大五倍,在100寸显示器上显示,它的放大倍率就变成了

100×10×5×【√(221.4²+124.5²)÷√(4.8²+6.4²)】

5000×317.5=1587500倍

这个放大倍率是没有任何意义的,全是马赛克。

排除这种极端的放大, 合理的搭配器材,也有不错的效果。

显微堆叠摄影的倍率计算

器材的不统一,呈现的载体的不同,倍率计算的混乱,让我们很难知道真实物体的大小,为了能让大家清楚的知道被摄物体大小,通常会在画面的左下角添加一个标尺。

在堆叠摄影中,几乎不会添加目镜,采取直焦摄影的方式,因为直焦摄影在分辨率上更有优势,且有更大的视野,即使倍率不够,也可以通过数码裁切的方式来获得更大的倍率,自由度更高。我们习惯性的标注物镜倍率(光学倍率),这跟显微镜添加目镜后的倍率一比很吃亏,大家一看标题这个几百几千倍,哇好厉害。

实际拍摄中,影响倍率的还有一个重要的因素,就是管镜焦距。

实际放大倍率=管镜焦距÷物镜标注焦距×物镜标注倍率

举个例子

我们所使用的Raynox DCR-150为例,屈光度4.8,焦距=1000÷4.8=208mm。

使用三丰20倍时,实际倍率=208÷200×20=20.8倍,

使用奥林巴斯20倍时,实际倍率=208÷180×20=23.14倍。

相关推荐

-

物镜的选择

-

组装光学平台